Việt Nam và foundation model AI: 3 tầng, 18 tháng, và cánh cửa hẹp đang đóng

Đường nào cho AI tại Việt Nam nhỉ ? Nghiên cứu hay cứ túc tắc viết ứng dụng thôi. Mà viết ứng dụng thì cần quái gì người giỏi AI quá =))

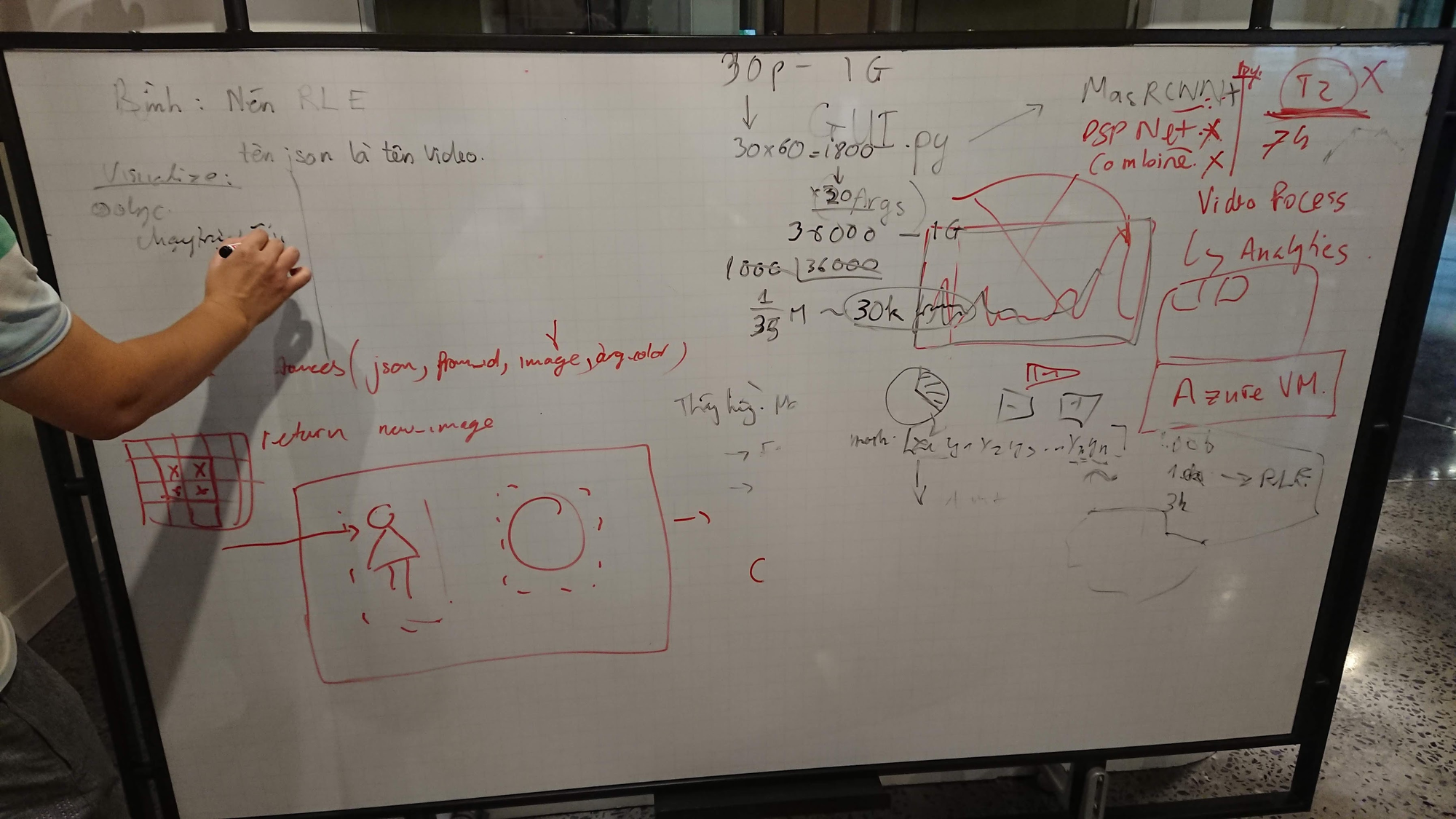

Khoảng 2018, đó là những năm mình thấy đẹp nhất trong career làm AI. Bọn mình ngồi đọc paper CNN, lần lượt SSD rồi YOLO, rồi Mask R-CNN. Mỗi paper là một cung điện kiến thức mới. Anh em chuyền tay nhau như bí kíp võ công: ai đọc xong từng phần thì kể lại trong group chat, vẽ kiến trúc backbone lên giấy, cãi nhau về loss function, anchor box, non-maximum suppression. Mình nhớ một buổi cà phê dài 4 tiếng chỉ để đập đi đập lại câu hỏi tại sao YOLO v3 lại dùng 3 scale prediction. Đó là cảm giác đang ngồi trong thứ gì đó còn đang được xây, và mình là một trong những người đang xây.

Bây giờ thì khác. Khi mình nói chuyện AI với anh em làm tech ở Việt Nam, mình ít nghe ai nói về kiến trúc mô hình, loss function, hay optimizer nữa. Toàn nói về LLM nào vừa ra, giá API tuần này so với tuần trước, OpenAI vs Anthropic vs Google. Toàn nói về repo router API, bộ skill cho Claude Code, UI bóng bẩy cho một LLM endpoint, prompt set nào đang viral, integration mới giữa Claude với một SaaS nào đó. Thành thật mà nói, mình khá chán mấy cái này. Không phải vì chúng không hữu dụng. Chúng có ích cho công việc, và mình cũng dùng hằng ngày. Mà vì chúng đều ở tầng 3, và tầng 3 đang nuốt toàn bộ không gian conversation về AI ở Việt Nam. Tầng 2, chỗ thật sự xây ra IP, gần như biến mất khỏi câu chuyện.

Đó là tâm trạng của mình buổi tối tháng 4 năm ngoái, khi đọc một thông cáo báo chí ngắn của Qualcomm: họ mua đội research và GenAI của VinAI. Bui Hai Hung, người sáng lập, từ giờ là VP of Technology tại Qualcomm AI Research (VinAI, 2025).

VinAI là một trong số ít lab Việt Nam từng lọt top 25 industrial AI lab thế giới về số paper ở NeurIPS và ICML. PhoGPT, model tiếng Việt 4B param, pretrain từ đầu trên 102B tokens, là dự án chủ lực của họ (arXiv:2311.02945). Mình từng dùng PhoGPT làm baseline cho một dự án nội bộ năm 2024. Repo PhoGPT trên GitHub bây giờ có 26 commit, 3 issue mở, 0 pull request, "no releases published" (VinAIResearch/PhoGPT). Lần phát hành model cuối là tháng 11/2023.

Trong cùng quãng thời gian đó, GoTo và Indosat ở Indonesia đẩy Sahabat-AI từ 9 tỷ tham số (11/2024) lên 70 tỷ (06/2025) (GoTo, 2025).

Singapore trong cùng quãng đó đẩy SEA-LION lên v3.5 70B rồi v4 multimodal với 256K context, được nuôi bằng quỹ 70 triệu SGD của National Multimodal LLM Programme (IMDA, 2023; SEA-LION, 2026). Mình đã từng tin Việt Nam có thể nhảy thẳng vào tầng ứng dụng và thế là đủ. Sau buổi tối đó, mình bắt đầu nghi ngờ niềm tin đó.

Bài viết này là một cuộc tính toán lại. Mình muốn vẽ rõ ba tầng của ngành AI, soi địa chính trị từng tầng, rồi quay lại câu hỏi: ở đâu là cánh cửa còn đang mở cho researcher Việt, và quan trọng hơn, ai sẽ trả tiền để chúng ta đi qua?

Ba tầng, bản đồ tỉnh táo

Để nghĩ rõ chuyện này, mình thấy phải dừng lại ở một việc cơ bản: phân tách ba tầng. Khi mình nói "ngành AI", thực ra đó là ba ngành rất khác nhau xếp chồng lên nhau, mỗi tầng có chủ riêng, biên lợi nhuận riêng, và rào cản gia nhập riêng. Mình đã thử trộn ba tầng trong một loạt buổi cà phê hai năm qua và mỗi lần đều ra kết luận sai. Lẫn lộn ba tầng là cách nhanh nhất để phân tích sai chiến lược.

Tầng 1, Hạ tầng. Silicon, EUV lithography, fab, packaging, GPU, datacenter, cao tốc cáp quang xuyên đại dương. Đây là tầng vật lý. Cần CapEx hàng chục tỷ USD, cần 20 năm tích lũy IP, cần nhân lực semiconductor mà thế giới đang thiếu. Khách hàng là tầng 2 và tầng 3. Người chơi: TSMC, ASML, NVIDIA, Samsung Foundry, một ít Intel còn sót lại, và một loạt OSAT (outsourced assembly and test) như Amkor, ASE.

Tầng 2, Công nghệ lõi. Foundation models, framework training (PyTorch, JAX), inference engine (vLLM, TensorRT-LLM), tokenizer, dataset pipeline, post-training research (RLHF, DPO, GRPO, agentic RL). Đây là tầng IP. Cần nhân tài đỉnh, cần compute để pretrain, cần vài năm research để có model cạnh tranh được. Khách hàng là tầng 3. Người chơi tuyến đầu: OpenAI, Anthropic, Google DeepMind, Meta, xAI, DeepSeek, Alibaba Qwen, Moonshot Kimi. Người chơi vùng: Mistral (FR), Falcon (UAE), SEA-LION (SG), Sahabat-AI (ID).

Tầng 3, Ứng dụng. SaaS chạy trên API của tầng 2, vertical AI cho ngành (luật, y, tài chính, giáo dục), agent platforms, công cụ AI cho developer. Đây là tầng phân phối và domain knowledge. Rào cản thấp, ra thị trường nhanh, biên lợi nhuận sẽ bị bóp khi model trở thành hàng hóa phổ thông. Khách hàng là người dùng cuối hoặc doanh nghiệp. Người chơi: hàng chục nghìn startup, từ Cursor đến Notion AI đến TopCV đến AI Hay.

Quy luật quan trọng nhất của bản đồ này: giá trị bị hút lên tầng cao hơn khi tầng đó còn khan hiếm, và bị đẩy xuống tầng thấp hơn khi tầng kia trở nên bão hòa. Hôm nay, tầng 1 vẫn cực kỳ khan hiếm. Đó là lý do NVIDIA đang giữ ~86% market share AI accelerator và data center segment đạt 62 tỷ USD riêng Q4 FY2026 (NVIDIA / Visual Capitalist, 2025). Tầng 2 đang bị Trung Quốc + open weights ép biên: DeepSeek V4 chỉ tốn 27% FLOPs so với V3.2 ở 1M context, và toàn bộ trọng số công khai. Tầng 3 vẫn còn nhiều dư địa lợi nhuận, nhưng đó là vùng cạnh tranh khốc liệt nhất.

Việt Nam đang chơi gần như toàn bộ ở tầng 3.

Tầng hạ tầng, cuộc chơi đã đóng từ lâu

Mình muốn dứt khoát ở đây vì còn nhiều người vẫn nghĩ Việt Nam có thể "tự chủ AI" bằng cách mua GPU nhiều hơn. Không. Tự chủ AI bằng cách mua máy NVIDIA là một thứ ảo tưởng tinh vi.

Cấu trúc thật của tầng 1 là một chuỗi nút thắt xếp tuyến tính:

- ASML độc quyền EUV lithography. Không ai khác làm được máy in chip dưới 7nm. Hà Lan đã đóng cửa xuất khẩu EUV sang Trung Quốc, và từ 09/2024 cập nhật license cho cả DUV immersion theo chính phủ Hà Lan (ASML press release, 2024). Chỗ này không có người thứ hai.

- TSMC sản xuất phần lớn chip tiên tiến của thế giới (NVIDIA Blackwell, Apple M-series, AMD Ryzen). Samsung Foundry và Intel có yield kém hơn ở node 3nm/2nm. Mình đã thử lập một bài luận hai năm trước rằng Samsung sẽ catch up ở 2nm; nhìn lại thấy mình đã quá lạc quan, gap thực ra đang nới rộng.

- NVIDIA thiết kế GPU và sở hữu CUDA, rào chắn phần mềm đã xây 17 năm. Q4 FY2026 data center revenue 62 tỷ USD, full-year 194 tỷ USD, market share AI accelerator ~86% (Motley Fool, 2025). Con số 86% là điều mình phải đọc lại ba lần để tin. Đây là độc quyền ở mức mà ngay cả Microsoft, Google, Amazon (những cloud provider lớn nhất thế giới) cũng không phá nổi dù họ tự design chip riêng (Trainium, TPU, MAIA).

Trong sơ đồ này, chương trình "sovereign AI" (AI có chủ quyền) mà NVIDIA đang đi marketing khắp nơi không phải là độc lập. Nó là một ràng buộc vĩnh viễn vào CUDA stack. Khi UK đặt cọc xây AI factories đến 2026 (NVIDIA, 2025), khi Saudi Arabia ký với HUMAIN cho 18,000 GB300 ban đầu, kế hoạch lên 600,000 GPU trong 3 năm (CNBC, 2025), khi FPT cam kết 200M USD cho AI Factory Việt Nam với hàng nghìn H100 (Vietnam News, 2024): tất cả đều là khách hàng. Là người đi thuê, không phải chủ nhà.

Việt Nam có một cánh cửa hẹp duy nhất ở tầng này, và nó không phải thiết kế chip mà là packaging và assembly. Intel có nhà máy lớn nhất thế giới về CPU packaging và test ở Saigon Hi-Tech Park, xử lý khoảng một nửa sản lượng toàn cầu của Intel. Amkor đang đầu tư 1.6 tỷ USD cho fab packaging 200,000m² ở Bắc Ninh, công suất dự kiến 3.6 tỷ đơn vị/năm (Vietnam Briefing, 2025). Quyết định 1018/QĐ-TTg đặt mục tiêu đào tạo 50,000-100,000 kỹ sư bán dẫn đến 2030. Thị trường bán dẫn Việt Nam ước đạt 10.16 tỷ USD năm 2025, dự báo 16.51 tỷ USD năm 2030.

Đây là tin tốt vừa phải. Packaging là phần thấp nhất của chuỗi giá trị: biên lợi nhuận TSMC ở phần fab khoảng 50%+, OSAT của Amkor khoảng 17-22%. Việt Nam đang vào chuỗi cung ứng ở khúc lao động và đất đai thay thế Trung Quốc trong làn sóng "China+1", không phải khúc IP. Đó vẫn là việc đáng làm. Nó tạo việc làm có kỹ năng, nó kéo theo đào tạo nhân lực và chuỗi cung ứng. Nhưng mình muốn nói thẳng: nếu ai đó hỏi "Việt Nam có làm chủ tầng hạ tầng không?", câu trả lời là không, sẽ không, và đó không phải nơi nên kỳ vọng. Mình đã tốn không ít thời gian đọc các bài "Việt Nam sẽ thành cường quốc bán dẫn" và đa phần là mơ.

Cuộc chơi tầng 1 đã đóng. Tiếp tục.

Tầng công nghệ, chỗ Việt Nam đang vắng mặt

Tầng 2 (foundation model + post-training research) là tầng IP có biên lợi nhuận cao nhất nhưng Việt Nam gần như không có người chơi. Singapore qua SEA-LION, Indonesia qua Sahabat-AI, Saudi qua ALLaM đều có model tier-1 riêng cho ngôn ngữ của họ. Việt Nam có PhoGPT 2023, nhưng repo đã đứng yên 18 tháng, và đội research VinAI vừa bị Qualcomm mua tháng 4/2025.

Đây là tầng mình muốn nói lâu, vì đây là tầng quan trọng nhất và cũng là tầng Việt Nam đang bỏ trống mà ít ai gọi tên.

Tuyến đầu (GPT-6, Claude 5, Gemini 3) đã đóng cho mọi nước ngoài Mỹ và Trung Quốc. Anthropic đốt 5 tỷ USD/năm, OpenAI nhiều hơn (mình đã viết kỹ về bài toán financing tuần hoàn Google-Anthropic-OpenAI ở bài khác). Phía Trung Quốc, DeepSeek V4 với canh bạc 1 triệu token context cho thấy open-weight Trung Quốc đang ép giá tầng tuyến đầu xuống mức không ai dự kiến. Để pretrain một foundation model tuyến đầu năm 2026 cần khoảng 100,000 H100-equivalent chạy vài tháng. Đó là CapEx mà chỉ Mag-7 + một vài hyperscaler Trung Quốc (ByteDance, Alibaba, Tencent, DeepSeek) chi nổi. Việt Nam, Indonesia, Singapore, Pháp, Israel: tất cả đều không phải người chơi ở nấc này, và sẽ không bao giờ là.

Nhưng tầng 2 không chỉ có tuyến đầu. Có một tầng giữa quan trọng đang nở rộ ba năm qua: vertical foundation model cho ngôn ngữ và văn hóa cụ thể, xây trên nền open weights (Llama, Gemma 4, Qwen, DeepSeek). Đây là chỗ mà quốc gia tầm trung CÓ THỂ chen được. Và nhiều nước đã chen.

Mỗi điểm là một bản model phát hành; đường kẻ là nhịp ra phiên bản. PhoGPT đứng yên từ cuối 2023, MaLLaM dừng ở 5B đầu 2024, trong khi SEA-LION đi qua 4 thế hệ và Sahabat-AI nhảy từ 9B lên 70B trong 7 tháng. Đường đỏ đứt: 04/2025, Qualcomm mua đội research VinAI.

Mình đi qua từng đối thủ trong vùng để bạn thấy bức tranh:

Singapore, SEA-LION. Được National Research Foundation cấp 70 triệu đô Singapore (~52 triệu USD), duy trì liên tục 2023-2026, nuôi cả AI Singapore lẫn ASTAR. SEA-LION v3.5 là Gemma-2-Llama 70B finetune cho 13 ngôn ngữ Đông Nam Á, v4 vừa phát hành tháng 3/2026 với multimodal, 256K context, OCR đặc thù vùng (SEA-LION blog, 2026). Đội < 30 người, sản phẩm là một họ model open-source bao gồm cả tiếng Việt. Câu nói khó nghe: model tiếng Việt tốt nhất hiện nay được xây ở Singapore, không phải Việt Nam.*

Indonesia, Sahabat-AI. GoTo (Tokopedia + Gojek) hợp tác Indosat Ooredoo Hutchison (viễn thông). v1 9 tỷ tham số tháng 11/2024, v2 70 tỷ tham số tháng 6/2025 (Fortune, 2025). Hỗ trợ Bahasa Indonesia, Javanese, Sundanese, Balinese, Bataknese. Tối ưu để chạy trên 2 H100, dữ liệu lưu trong lãnh thổ Indonesia. Đây không phải tiền nhà nước. Đây là 2 công ty tư nhân chia phí xây LLM chủ quyền cho ngôn ngữ của họ. Nhịp phát hành: 7 tháng từ 9B sang 70B.

Malaysia, MaLLaM. Mesolitica, một startup, phát hành MaLLaM 1.1B/3B/5B từ 1/2024, train trên 90B tokens Malay, được NVIDIA và Microsoft hỗ trợ compute. Nhỏ, nhưng có. (arXiv:2401.14680)

Vùng Vịnh, Falcon và ALLaM. UAE qua TII Abu Dhabi đã phát hành Falcon 7B → 180B và Mamba hybrid. Saudi qua PIF đứng sau HUMAIN với ALLaM 34B, train trên 500B token Arabic, kèm cam kết 600,000 GPU NVIDIA trong 3 năm (Arab News, 2025). Đây là sovereign AI theo nghĩa khác hẳn: không cần ROI, chỉ cần không bị OpenAI sở hữu mọi infrastructure tiếng Arabic. Việt Nam chắc chắn không có 10 tỷ USD kiểu PIF, nhưng case này quan trọng vì nó cho thấy giới hạn trên: khi một quốc gia thật sự muốn, họ sẽ đặt nguyên một quỹ chủ quyền vào bài toán này.

Việt Nam. PhoGPT 4B từ 11/2023: repo im, không có bản mới. ViGPT của VinBigdata 12/2023, đóng vào ứng dụng nội bộ. ViLLaMA, VinaLLaMA là sản phẩm học thuật. Viettel có VDA cho tổng đài, không công bố weights. Zalo có KiLM nội bộ. Không có một bản model tier-1 open-source nào của Việt Nam được phát hành trong 18 tháng qua. Và rồi tháng 4/2025, Qualcomm mua nguyên đội research và GenAI của VinAI: rebrand thành Movian AI, headquartered tại Hà Nội nhưng output thuộc Qualcomm (Qualcomm press release, 2025). Không phải mua công ty, mà mua phần não.

Có một dự án mới đáng nhắc: Project ViGen, launch tháng 3/2025 bởi NIC (Vietnam National Innovation Center) + Meta + AI for Vietnam Foundation, có Viettel, NVIDIA, Viện Hàn lâm KH&CN VN làm partner (Project ViGen, 2025; VOV English, 2025).

Roadmap 3 năm 2025-2027. Phase 1 (kết thúc 10/2025): Meta đóng góp 12+ open-source dataset tiếng Việt. Phase 2 (2026): build 10 evaluation framework + tools + hackathon quốc gia. Phase 3 (2027): refined dataset + advanced tools cho enterprise.

Đọc kỹ phạm vi ViGen sẽ thấy điều quan trọng: ViGen build dataset và eval, không build model. Output của ViGen là input cho Meta Llama (và LLM khác) hiểu tiếng Việt tốt hơn. Đây là partnership đáng giá theo nhiều cách: Meta technical expertise, NVIDIA compute, NIC governance. Nhưng nó cũng có nghĩa là Việt Nam đang chính thức export dataset moat tiếng Việt cho Meta. Khi Llama 5 hoặc Llama 6 fluent Vietnamese tier-1, đó sẽ là Llama của Meta, không phải LLM của Việt Nam. ViGen là phiên bản hợp tác của kịch bản "khách trọ" mà mình lo: chỉ là Việt Nam đồng ý làm khách trọ một cách formal, kèm dataset như tiền thuê.

Cam kết công khai cho chương trình LLM bản địa, log scale. Saudi và UAE chơi tỷ đô. Singapore 52M USD duy trì liên tục. Indonesia tư nhân + viễn thông. Malaysia một startup. Việt Nam: chưa có chương trình quốc gia nào dành riêng cho foundation model, quỹ AI 1 nghìn tỷ VND lập tháng 6/2025 dành cho startup nói chung, không phải pretrain model.

Khi mình ngồi nhìn hai biểu đồ này cạnh nhau, câu chuyện trở nên rõ ràng một cách khó chịu: không phải Việt Nam thiếu researcher giỏi. Mình tra lại số liệu cũ. VinAI năm 2022 ship 14 CVPR + 12 NeurIPS + 11 ICML + 11 ICLR, tổng 48 paper top-tier trong một năm, và là công ty Đông Nam Á duy nhất lọt top 20 Thundermark Capital "Global AI Research Companies" (VinAI, 2023). Đó không phải lab nhỏ. Đó là một trong những machine sản xuất paper AI mạnh nhất Đông Nam Á. Bằng chứng nhân tài đã có sẵn ở mức không thể phủ nhận.

Vấn đề là không có ai ở Việt Nam chịu trả tiền giữ họ ở lại làm tầng 2. Khi Qualcomm vào năm 2025, họ không cần thuyết phục. Họ chỉ cần ký séc.

Singapore trả. Indonesia trả (qua liên minh GoTo + Indosat). Saudi trả. UAE trả. Việt Nam có VinGroup, FPT, Viettel, CMC, và lựa chọn của các tập đoàn này đến giờ là: xây datacenter (FPT 200M USD cho NVIDIA AI Factory), xây cloud (CMC 250M USD), xây sản phẩm tiêu dùng (Zalo AI). Không ai trong số họ cam kết dài hạn cho việc xây foundation model open-weight của Việt Nam.

Tầng ứng dụng, bẫy lợi nhuận ngắn hạn

Mình đi sang tầng 3, nơi có lẽ bạn quen thuộc nhất nếu đang làm tech ở Việt Nam. Đây là chỗ đang nóng. Vốn VC vào AI startup Việt Nam tăng từ ~10M USD năm 2023 lên 80M USD năm 2024, và Q1/2025 đã vượt 130M USD (Deck Valley, 2025). Số AI startup từ 60 (2021) lên 278 (2024) lên 765 (2025). AI Hay gọi 10M USD Series A tháng 7/2025, có 100M lượt truy vấn/tháng. CMC C-OpenAI ra mắt 2024 với 250M USD cam kết hạ tầng. Quỹ AI nhà nước 1 nghìn tỷ VND lập tháng 6/2025 để hỗ trợ startup, SME, và FDI làm AI tại Việt Nam.

Đây đều là tin tốt. Mình không định nói VC đầu tư vào tầng ứng dụng là sai, họ đang làm đúng việc của họ. Vấn đề là bức tranh tổng thể: trong 765 AI startup đó, tỷ lệ khá lớn là wrapper, tức là sản phẩm của họ về cơ bản là một giao diện mỏng phủ lên API của OpenAI, Anthropic, hoặc Gemini. Không công ty nào công khai con số này, nhưng nếu bạn nói chuyện thẳng với founder, hoặc đọc kỹ tech stack trong các deck pitch, bạn sẽ thấy nó.

Nền kinh tế wrapper có hai vấn đề ai cũng nhìn ra nhưng không ai muốn nói to:

Một: Biên lợi nhuận sẽ bị bào. Giá API GPT-4-class đã giảm khoảng 90% từ 2023 đến 2025. DeepSeek V3.2 và V4 ép giá xuống thêm. Khi model trở thành hàng hóa phổ thông, lợi thế cạnh tranh duy nhất còn lại của wrapper là kênh phân phối và domain knowledge, và phần phân phối sẽ bị OpenAI/Anthropic ăn trực tiếp khi họ ra sản phẩm vertical.

Hai: Wrapper không tích lũy IP. Bạn không sở hữu model. Bạn không sở hữu post-training pipeline. Bạn không sở hữu eval. Khi thị trường đổi (provider thay đổi giá, ra model mới, ngừng API cũ), bạn phải viết lại. Một wrapper thành công 3 năm rồi bị OpenAI clone trong một sprint, đây là câu chuyện mình đã thấy lặp lại hai năm qua.

Cái bẫy không phải là làm wrapper. Cái bẫy là toàn bộ hệ thống (VC, nhà nước, đại học, big tech Việt Nam) đều đang tối ưu cho tầng 3 vì đó là chỗ kiếm tiền ngắn hạn rõ nhất. Khi tất cả nguồn lực dồn về tầng 3, không có ai chịu trả lương cho 50 researcher ngồi pretrain một bản model 70B tiếng Việt trong 2 năm. VinAI từng làm. Và VinAI vừa bị mua đi.

Steel-man: hai phản biện thật sự khó

Trước khi đi tiếp, mình muốn trình bày hai phản biện ở dạng mạnh nhất mình tìm được, không phải phiên bản dễ bác. Mình đã thử bác cả hai trong đầu nhiều lần và cả hai đều không gãy hoàn toàn. Đây là chỗ luận điểm bài này yếu nhất, và mình muốn nói thẳng.

Counter 1 (governance): "Việt Nam thiếu cấu trúc nhà nước để duy trì cam kết 5 năm cho một dự án không đo được bằng GDP. Vấn đề không phải tiền, mà là không ai trong bộ máy chịu trách nhiệm cho output research thuần túy."

Đây là phiên bản mà mình thấy khó nhất. Singapore làm được SEA-LION không phải vì có 70M SGD. Họ có 1 tỷ+ SGD trong 5 năm thông qua RIE 2025 plan, sustained qua AI Singapore + IMDA + A*STAR (MDDI Singapore, 2024).

Đây là cấu trúc 3 cơ quan đan xen, có ngân sách multi-year, có KPI research thuần (paper, model release, citation), và quan trọng nhất: không bị reset khi đổi chính phủ.

Việt Nam có Quyết định 1018/QĐ-TTg cho semiconductor, có quỹ AI 1 nghìn tỷ VND lập 6/2025, nhưng đây là instrument ngắn hạn, fragmented, và KPI vẫn nghiêng về số startup, số việc làm, số giải ngân. Không có equivalent của AI Singapore, một cơ quan có nhiệm vụ duy nhất là build research output trong 5-10 năm, chứ không phải đếm exit.

Người counter này nói tiếp: ngay cả khi VinGroup commit 30M USD cho VinAI v2, ai đảm bảo 3 năm sau VinGroup không cắt ngân sách lần nữa? Lịch sử cho thấy là không. VinAI là proof of concept: talent có, model có, paper có, nhưng vẫn bị mua đi vì không có ai ngoài VinGroup chia sẻ ngân sách. Một lab nghiên cứu lõi cần ít nhất 3 nguồn trả tiền độc lập để survive economic downturn. Việt Nam chưa có cấu trúc tạo ra 3 nguồn đó.

Bác lại: Counter này đúng về cấu trúc. Mình không cãi. Nhưng nó không invalidate luận điểm, nó cụ thể hóa luận điểm. Nếu vấn đề là governance, thì câu hỏi đúng là "ai cần thay đổi gì để có cấu trúc giống AI Singapore?" Và câu trả lời ngắn: cần một entity có authority cấp Bộ trở lên (Bộ KH-CN? Bộ TT-TT?), kèm một viện nghiên cứu nhà nước có ngân sách multi-year và KPI thuần research. Đây là một câu chuyện chính sách cụ thể, không phải lý do để đầu hàng. Và 24 tháng cho cánh cửa Vietnamese model là khung thời gian governance reform không cần đợi, vì một big tech VN (FPT, Viettel) hoặc một liên minh tư nhân (kiểu GoTo+Indosat) có thể đi trước trong khi nhà nước theo sau.

Counter 2 (ecosystem): "Researcher giỏi không ở lại dù được trả lương cao, vì môi trường research Việt Nam thiếu peer review culture, thiếu compute chia sẻ giữa các lab, và thiếu network hiệu quả với cộng đồng quốc tế. Vấn đề không phải tiền, mà là hệ sinh thái nghiên cứu chưa đủ critical mass."

Đây cũng là một phản biện mạnh. VinAI lúc đỉnh ship 48 paper top-tier/năm. Nhưng đó là một lab đơn lẻ, không phải hệ sinh thái. Khi VinAI bị Qualcomm mua, không có một VinAI #2 nào ở Việt Nam để hấp thụ talent. ML group ở VNU là nhỏ. HUST có vài nhóm đơn lẻ. FPT University và Hoa Sen có chương trình AI nhưng output paper top-tier khiêm tốn. Tổng số first-author paper NeurIPS/ICML/ACL từ VN-affiliation researcher mỗi năm: mình tin con số này dưới 30, đại đa số ra từ VinAI hoặc collaborator nước ngoài.

Critical mass nghĩa là gì cụ thể? Sahabat-AI list ra 6 đại học collaborator (UI, UGM, ITB, IPB, Udayana, USU) cộng với AI Singapore và Tech Mahindra. Đó là một mạng lưới ngang hàng đủ rộng để critique lẫn nhau, share dataset, replicate experiment. Việt Nam chưa có mạng lưới như vậy ở quy mô cần thiết.

Bác lại: Counter này đúng, và đó chính là lý do tại sao không thể đợi. Critical mass không tự sinh ra; nó được build qua một loạt project anchor. SEA-LION không tồn tại vì Singapore có sẵn ecosystem. Nó tồn tại vì AI Singapore quyết định chi 70M SGD để build ecosystem qua project. Cách họ giải quyết peer review culture đáng học: thay vì hire researcher rồi hy vọng họ tự network, AI Singapore kéo NUS, NTU, và A*STAR vào làm co-investigator từ ngày đầu. Nghĩa là output của project là paper chung, dataset chung, eval chung. Researcher không phải hire mới rồi giữ lại; họ đã ở đại học, project chỉ cần kéo họ vào và trả compute + lương phụ. Đây là cơ chế structural, nó không phụ thuộc vào lương cao nhất nước hay bonus retention.

Việt Nam có thể đi đường giống nhau: dùng một foundation model project lớn làm anchor, ký MoU với VNU/HUST/UEH/PTIT làm co-investigator chính thức từ ngày đầu (không phải vendor), commit shared compute từ FPT AI Factory cho các đại học này. Researcher không cần "ở lại Việt Nam" theo nghĩa cũ: họ vẫn có thể là PhD student/postdoc ở đại học, vẫn có khả năng lên paper top-tier với affiliation Việt Nam, vẫn có path career trong nước. Đây không phải lương. Đây là cấu trúc giữ người. VinAI vận hành như silo: khi VinGroup đóng cửa, không có chỗ nào hấp thụ. Sahabat-AI/SEA-LION vận hành như network: nếu một collaborator rút, project không sụp.

Đây vẫn là chicken-and-egg, và lời giải duy nhất là phá nó bằng một initiative đủ tham vọng để force ecosystem hình thành xung quanh nó. Nhưng cấu trúc network đa-bên là then chốt, không phải scale của ngân sách.

Một điểm cuối: sau khi viết hai counter này, mình thừa nhận mình kém tự tin hơn về tính khả thi so với khi bắt đầu bài. Counter governance đặc biệt đau, vì nó implicitly nói rằng vấn đề không phải VC, không phải researcher, không phải corporate, mà là ai sẽ đứng ra chịu trách nhiệm chính trị. Đó là câu hỏi mình không trả lời được trong bài này. Mình để ngỏ.

Pivot, câu hỏi đúng

Ngồi viết đến đây mình mới nhận ra: mình đã đặt câu hỏi sai từ đầu.

Câu hỏi sai là: "Việt Nam có làm được foundation model không?". Câu hỏi này dẫn đến tranh luận về tài năng, về vốn, về thời điểm: toàn những thứ không kết luận được vì ai cũng có thể chọn dữ liệu thuận theo ý mình.

Câu hỏi đúng là: "Ai sẽ là chủ của tiếng Việt trong AI?"

Và phiên bản dài hơn: ai sẽ là người định nghĩa tokenizer chuẩn tiếng Việt cho LLM? ai sẽ xây bộ eval đặc thù tiếng Việt mà các provider quốc tế phải vượt qua? ai sẽ phát hành reasoning trace tiếng Việt, dataset instruction-following tiếng Việt, dữ liệu căn chỉnh văn hóa Việt? ai sẽ nhận phí license khi một LLM nước ngoài muốn phục vụ tiếng Việt tier-1?

Đó không phải câu hỏi học thuật. Đó là câu hỏi về chủ quyền ở tầng 2: không phải chủ quyền của phần cứng (đã mất), mà chủ quyền của tầng biểu diễn, tức cách LLM hiểu, sinh, và lý luận trên tiếng Việt và văn hóa Việt.

Singapore đã trả lời: "chúng tôi". Indonesia đã trả lời: "chúng tôi". Saudi và UAE đã trả lời: "chúng tôi". Câu trả lời mặc định nếu Việt Nam không làm gì: Sahabat-AI, SEA-LION, hoặc trực tiếp OpenAI/Anthropic (tức Singapore, Indonesia, hoặc Mỹ) sẽ là chủ.

Điều này có sao không? Có. Vì khi anh chủ ở chỗ khác, model sẽ thiên kiến theo dữ liệu anh ta có. Thiên kiến chính trị, thiên kiến văn hóa, thiên kiến kiểm duyệt nội dung, thiên kiến về thông tin nhạy cảm. Không phải mưu đồ. Chỉ là entropy. Mỗi LLM đều phản chiếu cái khối dữ liệu nó được train, và khối dữ liệu đó luôn nghiêng về nơi sản xuất.

Đây là chỗ mình đặt cược. Mình tin rằng nếu đến cuối 2027 (khoảng 18 tháng tới, tính từ tháng 4/2026) không có một tổ chức Việt Nam ship một bản open-weight model 30B+ tier-1 cho tiếng Việt, thì tiếng Việt trong AI sẽ thuộc về Singapore (qua SEA-LION) trong 5-10 năm tiếp theo. Không phải về mặt pháp lý: không ai cấm Việt Nam làm sau. Mà về mặt thực tế: SEA-LION v5 hoặc v6 sẽ là model default mà mọi developer Việt Nam dùng cho tiếng Việt, mọi app sản xuất sẽ build trên top của nó, mọi dataset benchmark Vietnamese tier-1 sẽ là thứ AI Singapore curate. Lúc đó, "làm model tiếng Việt" sẽ không còn ý nghĩa kinh tế. Kiểu như giờ làm thử một search engine tiếng Việt mới để cạnh tranh Google. Cánh cửa kinh tế đóng trước cánh cửa kỹ thuật.

Đây là prediction mình sẵn sàng sai. Nếu cuối 2027 có bản model như vậy ship ra, mình sẽ viết bài thừa nhận. Nếu không có, hãy đọc lại bài này.

Cánh cửa hẹp, nó nằm ở đâu cụ thể

4 cửa cụ thể cho researcher Việt: (1) post-training research trên open weights, chi phí 2-20K USD/paper; (2) vertical Vietnamese model 30-70B, 6-10M USD năm đầu; (3) dataset/eval tier-1 cho domain-specific (luật, y, tài chính), 300-700K USD; (4) on-device cho ngôn ngữ dân tộc thiểu số, 100-300K USD. Cửa 2 và 3 đang đóng trong 12-18 tháng tới.

Mình muốn dứt khoát ở phần này vì đây là phần dễ trượt thành trừu tượng nhất. Trước khi liệt kê các cửa, mình muốn đóng đinh một con số quan trọng: làm vertical foundation model bây giờ rẻ hơn 1000 lần so với pretrain from scratch.

Llama 3.3 70B Meta pretrain hết 39.3 triệu H100-hours (Meta model card). Đó là CapEx khoảng 100-150M USD chỉ riêng compute. Nhưng SEA-LION v3 70B, finetune từ Llama trên 200B tokens Đông Nam Á, chỉ tốn 495 giờ wall-clock trên cluster AWS p5e.48xlarge và SingTel HGX-100 (Nvidia H200/H100), global batch size 512 (SEA-LION v3 blog).

AI Singapore không công bố cluster size, nhưng AWS p5e.48xlarge mỗi instance là 8 H200, và để train 70B model với global batch 512 ở wall-clock 495 giờ thì cần tối thiểu 64-128 GPU. Tính conservative: 64 H200 × 495h ≈ 31,700 GPU-hours; 128 GPU × 495h ≈ 63,400 GPU-hours. Ở cloud rate 3-6 USD/H200-hour, tổng compute SEA-LION v3 70B rơi vào khoảng 95K-380K USD. Không phải con số 30-80K USD mình ước tính sơ bộ ban đầu (mình đã sai, vì confuse wall-clock với GPU-hours). Cộng thêm dataset curation, post-training ~16.8M instruction, và lương team, tổng cost research-grade vertical 70B model thực tế nằm trong 500K-2M USD cho lần đầu. Vẫn rẻ hơn pretrain Llama 3.3 từ đầu hai bậc lớn (100M USD+), nhưng không phải đồ chơi. Đây là khoảng tiền cụ thể mà rất ít người Việt Nam đang nói chuyện AI nắm rõ.

Đây là 4 cửa cụ thể, theo thứ tự từ "đang mở" đến "đang đóng nhanh":

Cửa 1, Post-training research trên open weights (đang mở rộng nhất). Việt Nam KHÔNG cần pretrain. Cần là làm research trên nền open weights (Llama 3.3, Qwen 3, DeepSeek V4, Gemma 3): RLHF, DPO, GRPO, agentic RL, tool use, reasoning chain training. Một paper top-tier về post-training research thường làm được với cluster 8-32 H100 trong 1-3 tuần. Quy ra tiền: 2-20K USD compute cho một paper. Đây là chi phí thấp đến mức một lab đại học, một startup, hoặc thậm chí một researcher solo có gradnt FPT/VNG cũng làm được. FPT AI Factory đã ship 43 dịch vụ AI cloud, phục vụ 18,000 user toàn cầu (FPT AI Factory): chỉ cần phân bổ 1% công suất cho research access là dư cho nhu cầu cả nước. Đây là cửa ROI cao nhất, thời gian thấy kết quả ngắn nhất, và còn mở rất rộng.

Cửa 2, Vertical Vietnamese foundation model 30-70B (đang đóng trong 12-18 tháng). Một bản model finetune từ Llama 3.3 70B hoặc Qwen 3 trên ~200B token tiếng Việt + ngôn ngữ dân tộc, kèm post-training 5-10M instruction Vietnamese-specific, kèm eval moat trên các domain Việt (luật, y, tài chính). Lookback SEA-LION v3 cho thấy compute realistic: 64-128 H100/H200 trong 3 tuần ≈ 100-380K USD. Cộng dataset team 15-20 người trong 12 tháng (~2-3M USD lương), team research 10-15 người (~1.5-2M USD), tổng 6-10M USD cho lần đầu, 2-3M USD/năm để maintain. Đây không phải con số 30M USD như mình nghĩ ban đầu. Mình đã sai trong draft đầu, và mình sửa. Sahabat-AI có cấu trúc tham khảo trực tiếp: GoTo + Indosat (qua Lintasarta GPU Merdeka tự sở hữu) + 6 đại học collaborator + AI Singapore + Tech Mahindra (GoTo press release, 2025). Việt Nam có thể copy chính xác khuôn này: FPT (compute) + Viettel hoặc Vingroup (telecom + capital) + VNU/HUST/UEH (academic) + một technical advisor quốc tế. Cửa này còn 12-18 tháng trước khi SEA-LION v5 hoặc Sahabat-AI v3 chiếm hết Vietnamese tier-1 use case.

Cửa 3, Dataset và rào chắn evaluation (đang được claim bởi ViGen + Meta, phải pivot). Cửa này là phần phức tạp nhất sau khi ViGen launch. Phần general-domain Vietnamese dataset (12+ dataset Meta đã contribute) đã được giải quyết. Phần Vietnamese eval framework cũng đang được build: ViGen Phase 2 (2026) cam kết 10 evaluation framework. Nếu một researcher Việt vào "build Vietnamese dataset" mà không có angle khác, họ đang cạnh tranh trực tiếp với một liên minh có Meta, NVIDIA, và Viettel.

Nhưng cửa này không đóng. Nó dịch chuyển. Vẫn còn 3 ngách rõ ràng: (1) dataset domain-specific tier-1 cho luật/y/tài chính/giáo dục VN (ViGen làm general, không làm specialty depth; Sahabat ký với Hukumonline cho Indonesian legal là precedent đáng học); (2) dataset cho ngôn ngữ dân tộc thiểu số mà Meta không quan tâm; (3) commercial-licensed dataset mà ViGen open-source license không cover được (enterprise cần dataset có IP commercial-clear để train internal model). Mỗi cửa con này cần ~300K-700K USD cho team 5-8 người trong 12 tháng. Khác biệt với cửa cũ: bạn không thể là người đầu tiên build "Vietnamese dataset" nữa. Bạn phải là người đầu tiên build "Vietnamese legal dataset commercial-grade" hoặc tương tự.

Cửa 4, On-device cho ngôn ngữ dân tộc thiểu số (đang mở vừa, niche bền). Một model 1-3B param chạy trên smartphone tầm trung, tốt cho tiếng Việt và 5-7 ngôn ngữ dân tộc (Thái, H'mông, Khmer Krom). Đây là cửa thị trường quá nhỏ cho US lab và quá đặc thù cho Trung Quốc: không ai khác muốn. Compute cần ~100-300K USD. Nhu cầu thật từ giáo dục vùng cao, dịch vụ công vùng dân tộc, telemedicine. Đây không phải bet về kinh tế. Đây là bet về xã hội và sự duy trì ngôn ngữ. Nhưng nó là cửa duy nhất mà Việt Nam có structural moat tự nhiên vì không ai khác có lý do đầu tư.

Mình bỏ phần "embodied AI / robotics foundation model" mà draft đầu đề cập. Sau khi research thêm, mình thấy cửa đó cần CapEx và industrial partnership ở mức Việt Nam chưa có capability. Để dành cho bài khác, hoặc cho một researcher có background cụ thể về robotics chứng minh được path khả thi.

Cần gì để qua các cửa này? Không phải tài năng, Việt Nam có. Cần ba điều:

Một, một entity chịu cam kết 3-5 năm với ngân sách multi-year. Theo mô hình AI Singapore (1B SGD trong 5 năm), Việt Nam cần một equivalent ở quy mô ít nhất 50-100M USD qua 5 năm, mà nếu nhà nước chia 3 với 2-3 big tech VN thì mỗi bên chỉ phải bỏ 5-7M USD/năm. Đây không phải con số xa xỉ: đó là 1/40 ngân sách FPT AI Factory đã đầu tư cho infrastructure rental.

Hai, một cấu trúc governance vượt cycle chính trị. Đây là phần khó nhất, và là counter-argument 1 mình đã thừa nhận ở phần steel-man. Cần một viện hoặc agency có authority cấp Bộ trở lên, KPI thuần research (paper top-tier, model release, citation index, eval moat), không bị reset khi đổi chính phủ. Mô hình A*STAR + AI Singapore của Singapore là template, chứ không phải một quỹ ngắn hạn 1 nghìn tỷ VND giải ngân theo năm.

Ba, kiên nhẫn với kết quả không đo được bằng MAU. Một bài paper top-tier không sinh ra doanh thu. Một bản model open-weight không có ARR. Đây là loại đầu tư mà Singapore National Research Foundation hiểu, mà PIF Saudi hiểu, mà, đáng buồn, đa số VC và tập đoàn Việt Nam chưa hiểu.

Kết, câu hỏi mình mang theo

Mình bắt đầu bài này bằng buổi tối tháng 4 năm ngoái, khi đọc thông cáo Qualcomm mua VinAI và phải đứng dậy đi pha trà. Một năm sau, ngồi viết lại, mình vẫn chưa có câu trả lời gọn gàng.

Cái mình tin chắc hơn là cách đặt câu hỏi đã sai. 5 năm nữa nhìn lại, câu hỏi không phải "tại sao Việt Nam không có OpenAI". Câu hỏi sẽ là: "ai đã trả tiền cho việc chúng ta không làm gì cả ở tầng 2?". Câu trả lời chắc sẽ phức tạp: VC bận đầu tư wrapper vì wrapper thoái vốn nhanh, big tech bận xây datacenter vì datacenter có công thức CapEx rõ, nhà nước bận hỗ trợ startup vì có chỉ số đếm được, đại học bận xuất bản paper chung chung vì lộ trình thăng tiến là thế. Mỗi người đều đang tối ưu cho cái họ đo được. Và không ai đo "ai sở hữu tiếng Việt trong AI".

Mình đã đặt cược cụ thể ở phần pivot: 18 tháng tới (đến cuối 2027) là cửa sổ kỹ thuật, đủ để một tổ chức nghiêm túc ship được model. Cửa sổ kinh tế (tức khoảng thời gian mà Vietnamese tier-1 còn chưa bị SEA-LION hoặc Sahabat-AI claim hoàn toàn) có thể rộng hơn một chút, mình estimate 24 tháng. Quá thời điểm đó, ngay cả khi ship được model, người dùng đã định hình thói quen với model khác. Đây là hai con số liên quan nhau, không mâu thuẫn: 18 tháng để build, 24 tháng là tổng thời gian thị trường còn open.

Cụ thể hơn: nếu trong 18 tháng tới có ít nhất một tổ chức ở Việt Nam (bất kỳ ai) chịu cam kết 6-10M USD và 20-30 researcher cho một bản Vietnamese foundation model 30-70B công bố weights công khai, thì câu chuyện này còn cứu được. Nếu không, chúng ta sẽ là khách trọ trong tiếng Việt của chính mình.

Nếu bạn đọc tới đây và nghĩ mình đang nhầm (về thời điểm, về bằng chứng, về luận điểm), mình thật sự muốn nghe. Cãi lại bằng số nếu được. Đây là loại tranh luận nên có nhiều người cùng nghĩ.

Bình