Cursor $29B Xây Trên Kimi K2.5 - Ai Đang Bán Gì Cho Ai?

Cursor Composer 2 bị phát hiện dùng Kimi K2.5 qua debug proxy. Model Moonshot AI bị Anthropic cáo buộc clone Claude 3 tuần trước. AI supply chain đang broken.

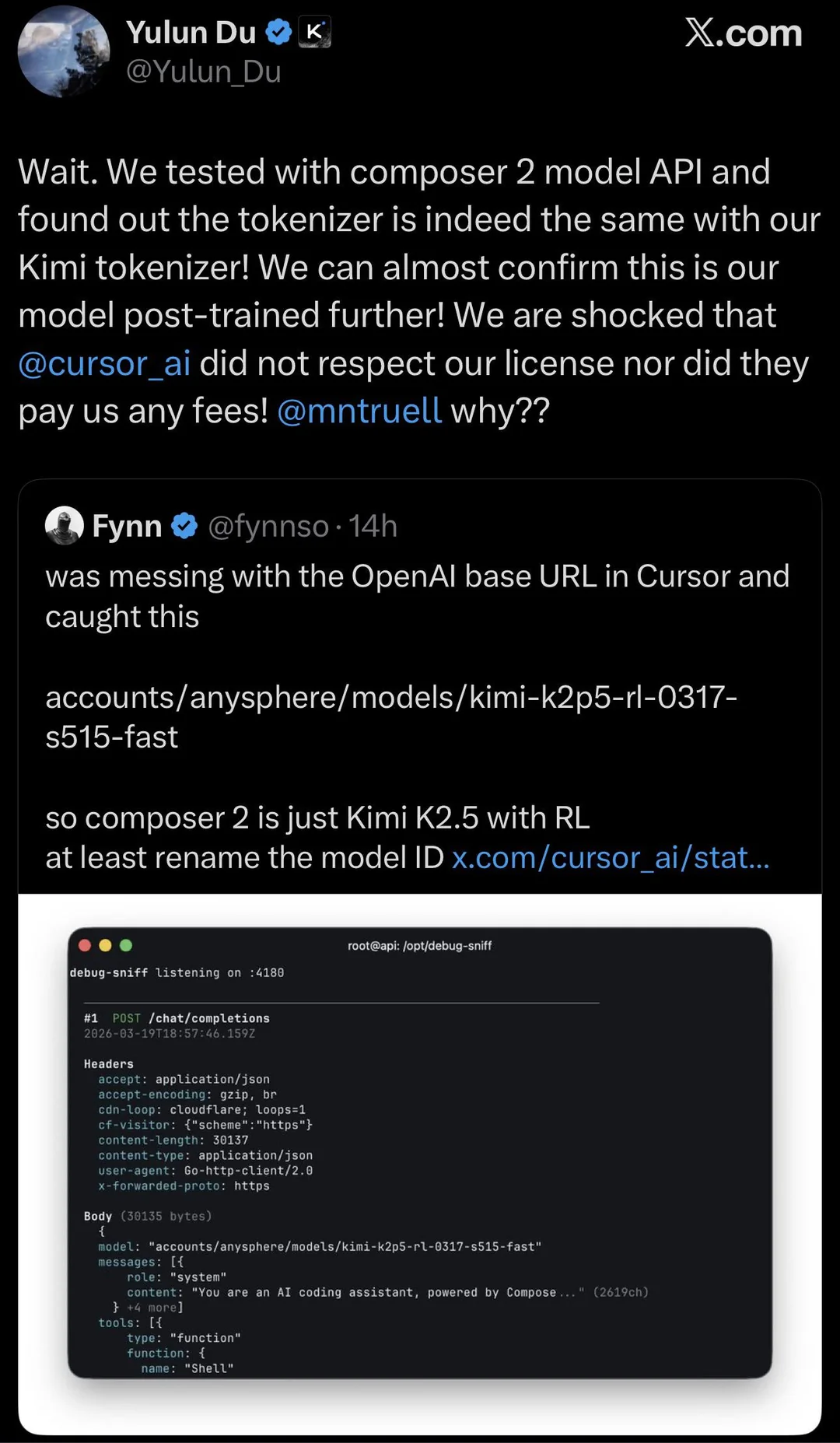

Một công ty trị giá 29.3 tỉ USD ra mắt "mô hình AI tự phát triển". Vài giờ sau, một developer dùng proxy debug phát hiện model ID gốc nằm ngay trong API response: kimi-k2p5-rl-0317-s515-fast. Moonshot AI - công ty tạo ra Kimi K2.5 - phản ứng: "Chúng tôi bị sốc." Rồi xóa tweet. Rồi chúc mừng Cursor. Chuyện gì đang xảy ra?

Ngày 19 tháng 3 năm 2026, Cursor - IDE coding AI được định giá 29.3 tỉ USD - phát hành Composer 2 với lời quảng cáo đầy tham vọng: "frontier-level coding intelligence", "our first continued pretraining run", reinforcement learning tối ưu cho coding. Blog post dùng đại từ "we" và "our" xuyên suốt. Không một dòng nào nhắc đến Kimi K2.5. Không một dòng nào nhắc đến Moonshot AI.

Cùng ngày, developer @fynnso (Fynn) - vì tò mò - route traffic API của Cursor qua local debug proxy. Thứ anh ta thấy không cần reverse engineering, không cần decompile, không cần gì phức tạp cả. Model identifier nằm ngay trong plain text: kimi-k2p5-rl-0317-s515-fast.

Decode cái tên: Kimi K2.5 base + reinforcement learning + ngày 17/3 (training date) + fast serving mode. Tweet của Fynn đạt 444,000+ views. Và cơn bão bắt đầu.

Cursor không chỉ "quên ghi nguồn". Họ đang xây narrative "AI research company" trị giá 29.3 tỉ USD trên nền tảng là fine-tune model open-source của Trung Quốc, trong khi chính model đó đến từ công ty bị Anthropic - đối tác lớn nhất của Cursor - cáo buộc distill Claude bất hợp pháp chỉ 3 tuần trước đó. Đây không phải drama attribution. Đây là lỗ hổng cấu trúc trong chuỗi cung ứng AI của cả ngành.

72 giờ từ "nghiên cứu độc quyền" đến thừa nhận

Hãy nhìn vào timeline để hiểu mức độ nghiêm trọng:

| Thời gian | Sự kiện |

|---|---|

| 19/3/2026, sáng | Cursor publish blog "Composer 2" - zero attribution |

| 19/3/2026, chiều | @fynnso phát hiện model ID kimi-k2p5-rl-0317-s515-fast qua proxy |

| 19/3/2026, tối | Yulun Du - Head of Pretraining tại Moonshot AI - test API, confirm tokenizer giống hệt, tweet: "We are shocked that @cursor_ai did not respect our license nor did they pay us any fees!" |

| 20/3/2026 | Yulun Du xóa tất cả tweets |

| 20/3/2026 | Elon Musk amplify: "Yeah, it's Kimi 2.5" |

| 21/3/2026 | Lee Robinson (VP Cursor) thừa nhận base model, claim "chỉ ~1/4 compute đến từ base" |

| 22/3/2026 | Moonshot AI official @Kimi_Moonshot đảo chiều 180 độ - chúc mừng Cursor, gọi là "authorized commercial collaboration" qua Fireworks AI |

| 22/3/2026 | Aman Sanger (co-founder Cursor): "It was a miss to not mention the Kimi base in our blog from the start" |

Hai chi tiết đáng dừng lại.

Yulun Du - Head of Pretraining, một trong những người senior nhất về kỹ thuật tại Moonshot - không biết về "thỏa thuận hợp tác" này. Ông test API Cursor như một người ngoài, phát hiện tokenizer giống hệt, rồi tweet phẫn nộ. Rồi bị buộc xóa. Điều này chỉ có hai khả năng: hoặc Moonshot có governance breakdown nghiêm trọng - Head of Pretraining không được thông báo về việc model của mình bị thương mại hóa - hoặc "thỏa thuận" được sắp xếp sau khi scandal nổ ra.

Và cú đảo chiều 180 độ của Moonshot. Từ "shocked" và "did not respect our license" sang "authorized commercial collaboration" chỉ trong 48 giờ. Trong business, khi một công ty trị giá $3.8B đột ngột chúc mừng công ty $29.3B sau cáo buộc vi phạm license - đó không phải là "hiểu lầm được giải quyết". Đó là deal được ký sau khi bị lộ.

Con số không biết nói dối

Kimi K2.5 được phát hành dưới Modified MIT License. MIT thông thường là một trong những license permissive nhất - gần như ai cũng có thể dùng cho mục đích gì cũng được. Nhưng Moonshot thêm một điều khoản cụ thể:

Sản phẩm có hơn 100 triệu monthly active users HOẶC revenue hơn 20 triệu USD/tháng phải "prominently display 'Kimi K2.5'" trong giao diện người dùng.

Làm phép tính nhanh. Cursor đạt $2 tỉ USD ARR vào đầu 2026 theo TechCrunch. Chia cho 12 tháng, ra khoảng $167 triệu/tháng. Ngưỡng trigger attribution: $20 triệu. Cursor vượt ngưỡng 8.35 lần.

Tính đến thời điểm viết bài, không có dòng chữ "Kimi K2.5" nào xuất hiện trong giao diện Cursor. Không trong app. Không trong blog - đã được sửa sau scandal, nhưng chỉ "acknowledge" chứ không "prominently display". Không trong marketing materials.

Cursor claim họ access Kimi K2.5 qua Fireworks AI - một platform hosting model. Câu hỏi pháp lý chưa ai trả lời: liệu một hosting agreement có satisfy được yêu cầu attribution ở UI level hay không? Chưa có precedent. Nhưng text của license rất rõ: prominently display in the user interface. Không phải "in the backend agreement" hay "in API documentation".

Con quái vật 1 nghìn tỉ parameter mà ít ai biết

Câu hỏi thực tế: tại sao Cursor muốn Kimi K2.5 đến mức chấp nhận rủi ro reputational? Câu trả lời nằm ở kiến trúc.

Kimi K2.5 dùng Mixture-of-Experts (MoE): tổng 1.04 nghìn tỉ tham số, nhưng mỗi lần inference chỉ activate 32 tỉ - tức ~3%. Hãy tưởng tượng một thư viện khổng lồ với 384 phòng chuyên gia, nhưng mỗi câu hỏi chỉ cần gõ cửa 8 phòng. Model có "kiến thức" của 1T-parameter dense model, nhưng chi phí chạy gần bằng model 32B. DeepSeek-V3 dùng cùng paradigm nhưng quy mô nhỏ hơn (671B total, 37B active, 256 experts). Kimi K2.5 nhiều experts hơn, context window gấp đôi (256K vs 128K), vocabulary lớn hơn (160K vs 128K tokens).

Moonshot không phải công ty "AI wrapper" bình thường. Founder Yang Zhilin là đồng tác giả Transformer-XL và XLNet - hai paper nền tảng mà bất kỳ ai học NLP đều phải đọc. Ông từng ở Google Brain và Meta trước khi lập Moonshot tháng 3/2023. Revenue tháng 11/2025: $240M với team ~80 người. Đang fundraise ở $18B valuation - nhảy từ $3.8B Series C chưa đầy một năm trước. Đây là lab nghiên cứu có credentials thật, không phải startup đi bọc lại API của người khác.

Kỹ thuật quan trọng nhất của dự án: MuonClip optimizer - variant kết hợp Muon với QK-Clip để ngăn "attention explosion" gây loss spikes. Khi train model ở quy mô hàng nghìn tỉ tham số, loss spikes - những đợt training loss tăng đột ngột - là ác mộng thường trực. DeepSeek-V3 gặp vấn đề này. MuonClip giải quyết triệt để: zero loss spikes trong suốt 15.5 nghìn tỉ tokens pre-training. Đây là lý do base model đủ chất lượng để Cursor xây dựng trên đó.

So sánh architecture với DeepSeek-V3:

| Thông số | Kimi K2.5 | DeepSeek-V3 |

|---|---|---|

| Tổng tham số | ~1.04T | ~671B |

| Active params/token | 32B | 37B |

| Số experts | 384 | 256 |

| Context window | 256K | 128K |

| Vocabulary | 160K | 128K |

Training pipeline K2.5:

- Continued pre-training ~15T tokens (text + visual)

- MoonViT-3D: Vision encoder 400M params - image và video

- SFT từ K2, K2 Thinking, và expert models nội bộ

- RL với CISPO (Clipped Importance-Sampled Policy Optimization) - 128 queries/step × 8 rollouts = 1,024 trajectories/step

- PARL (Parallel-Agent RL) - train orchestrator điều phối tới 100 sub-agents đồng thời

Generative Reward Models (GRMs) thay binary pass/fail bằng rubric đánh giá chi tiết - chống reward hacking ở quy mô lớn.

Benchmark nói gì - và tiền nói gì

Số liệu dưới đây tổng hợp từ paper arXiv:2602.02276 (Kimi K2.5), Artificial Analysis, và Cursor blog post. Scores của Kimi K2.5 verified từ paper gốc; scores Claude Opus 4.6 từ Anthropic và benchmark aggregators độc lập.

Coding: Kimi K2.5 vs Claude Opus 4.6

| Benchmark | Kimi K2.5 | Claude Opus 4.6 | Chênh lệch |

|---|---|---|---|

| SWE-Bench Verified | 76.8% | 80.8% | Opus +4.0 |

| SWE-Bench Multilingual | 73.0% | - | K2.5 dẫn đầu |

| LiveCodeBench (v6) | 85.0% | ~64% | K2.5 +21.0 |

| Terminal-Bench 2.0 | 50.8% | 65.4% | Opus +14.6 |

| HLE-Full (w/ tools) | 50.2% | ~43.2% | K2.5 +7.0 |

Reasoning & Vision

| Benchmark | Kimi K2.5 | Claude Opus 4.6 | Chênh lệch |

|---|---|---|---|

| AIME 2025 | 96.1 | ~92.8 | K2.5 +3.3 |

| GPQA-Diamond | 87.6 | ~87.0 | Gần bằng |

| MMLU-Pro | 87.1 | 89.3 | Opus +2.2 |

| MMMU-Pro (vision) | 78.5 | 74.0 | K2.5 +4.5 |

Bức tranh rõ ràng nhưng không đơn giản. Opus 4.6 thắng ở SWE-Bench Verified và Terminal-Bench - những benchmark đo khả năng làm việc với codebase thật, complex, multi-file. Kimi K2.5 thắng ở LiveCodeBench, HLE w/ tools, AIME, và vision. Nói cho dễ hiểu: Opus 4.6 là software engineer giỏi hơn, K2.5 là competitive programmer và agent mạnh hơn.

Nhưng benchmark chỉ là nửa câu chuyện. Nửa còn lại - nửa mà Cursor thực sự quan tâm - là tiền.

| Model | Input / Output (per 1M tokens) | Context Window |

|---|---|---|

| Composer 2 (Kimi K2.5 base) | $0.50 / $2.50 | 262K |

| Claude Opus 4.6 | $5.00 / $25.00 | 1M |

| GPT flagship | ~$2.50 / $15.00 | - |

Composer 2 rẻ hơn Claude Opus 4.6 10 lần ở output và 8.3 lần ở input. Opus 4.6 có context window lớn gần 4 lần (1M vs 262K) - advantage thật sự cho large codebase. Nhưng với đa số coding tasks hàng ngày, 262K tokens là thừa đủ.

Trên CursorBench nội bộ - benchmark do chính Cursor thiết kế để đo coding workflow thực tế:

| Model | CursorBench Score |

|---|---|

| GPT Thinking (flagship) | 63.9 |

| Composer 2 | 61.3 |

| Claude Opus 4.6 | 58.2 |

| Composer 1.5 | 44.2 |

Composer 2 vượt Claude Opus 4.6 trên chính sân nhà của Cursor, giá chỉ bằng 1/10. Khi bạn có $2B ARR nhưng gross margin âm - một investor tiết lộ thẳng: "Cursor đang chi 100% revenue cho Anthropic" - thì tìm được base model performance tương đương mà rẻ hơn 10 lần không phải "research opportunity". Đó là survival.

Ba thế hệ Kimi: Câu chuyện không ai kể

Để hiểu tại sao K2.5 nguy hiểm đến mức này, cần nhìn vào trajectory cả family - vì Moonshot không phải công ty đang bắt kịp. Họ đang dẫn một số race cụ thể.

K1.5 (01/2025) bắt đầu bằng một luận điểm đơn giản đến mức táo bạo: RL có thể scale cho LLM mà không cần Monte Carlo tree search, không cần process reward models, không cần value functions - những thứ mà OpenAI o1 dùng. Paper arXiv:2501.12599 chứng minh điều này bằng số: AIME 77.5, Codeforces percentile 94th, ngang o1. Và quan trọng hơn, long-to-short transfer - model học cách "compress" reasoning chain khi cần - cải thiện 550%.

K2 (07/2025) scale cả model lẫn data. MoE 1T params, nhưng đột phá thực sự là agentic data synthesis: 20,000+ synthetic tools, 3,000+ real GitHub repos được dùng để train model biết cách dùng tools như một engineer thật. SWE-Bench Verified 65.8%. Đây cũng là lần đầu Moonshot publish MuonClip - optimizer sẽ trở thành core infrastructure của K2.5.

K2.5 (01-02/2026) là kết quả tích lũy của cả hai: native multimodal (MoonViT-3D cho video), Agent Swarm framework (PARL - orchestrator điều phối tới 100 sub-agents song song), và tiếp tục scale RL. So với K2: SWE-Bench +11 points, LiveCodeBench +31 points, AI Office Benchmark +59.3%. Paper arXiv:2602.02276 có 324 contributors - scale của một dự án quốc gia, không phải startup 80 người.

Pattern qua ba iterations rất rõ: mỗi version là một bet lớn hơn vào RL và agentic capabilities. K2.5 không phải "model coding" tốt hơn - nó là nền tảng để build agents làm việc thay người, với coding là use case đầu tiên được chứng minh. Cursor nhìn thấy điều đó.

Chuỗi cung ứng AI đang broken - và không ai muốn nói về nó

Đây là layer mà hầu hết media bỏ qua, nhưng lại quan trọng nhất.

Tháng 2/2026, Anthropic cáo buộc Moonshot AI - cùng DeepSeek và MiniMax - sử dụng 24,000 tài khoản giả để generate 16 triệu+ exchanges nhằm distill Claude. Tức là chiết xuất khả năng của Claude thông qua querying hàng loạt. Anthropic gọi đây là "distillation attack".

Tháng 3/2026, Cursor - một trong những khách hàng lớn nhất của Anthropic - ra mắt Composer 2, built on top of Kimi K2.5. Model từ chính Moonshot AI mà Anthropic vừa cáo buộc.

Nếu cả hai đều đúng, hãy theo logic đến cùng:

- Moonshot distill capabilities từ Claude vào training data/process

- Kimi K2.5 có thể chứa "knowledge residue" từ Claude

- Cursor fine-tune Kimi K2.5 thành Composer 2

- Cursor đang bán capabilities có nguồn gốc từ Claude, được laundered qua Kimi K2.5, với giá rẻ hơn 10 lần

Tôi không nói đây là chuyện chắc chắn xảy ra. Nhưng đây là logical consequence của supply chain hiện tại. Và chưa ai trong ecosystem address vấn đề này.

Community đã lâu đặt câu hỏi: Cursor có phải "wrapper" không? Với Composer 2, câu hỏi trở nên sắc hơn. Nhìn vào stack thực tế: IDE là fork của VS Code (Microsoft). Chat và Agent mode dùng Claude (Anthropic) và GPT (OpenAI) qua API. Composer 1 - theo claims từ community - based on Qwen (Alibaba). Composer 2 confirmed based on Kimi K2.5 (Moonshot AI). Toàn bộ "proprietary AI" của Cursor, tính từ trên xuống dưới, là fine-tuned open-source hoặc third-party API.

Cursor tạo ra giá trị ở UX integration và workflow optimization. Đó là giá trị thật - 4 triệu developers không dùng Cursor vì nhầm nó với OpenAI. Nhưng $29.3 tỉ USD cho integration layer khi base model là open-source và có thể bị thay thế trong vài tháng? Câu hỏi đó giờ có data point cụ thể để trả lời.

Một investor nói thẳng với Fortune: "Cursor đang chi 100% revenue cho Anthropic." Gross margin âm. Và giải pháp của họ là... xây model riêng trên base open-source Trung Quốc.

Rồi nhìn rộng hơn. Kimi K2.5 (Modified MIT), DeepSeek-V3 (MIT), Qwen (Apache 2.0) - các model open-source mạnh nhất thế giới đều đến từ Trung Quốc. Trong khi đó, Meta's LLaMA có license hạn chế hơn, Google's Gemma cũng vậy. Kết quả là các sản phẩm AI phương Tây đang được xây trên nền tảng mở của Trung Quốc - không phải vì yêu thích open-source, mà vì đó là model tốt nhất mà họ có thể legally fine-tune mà không tốn tiền license.

Enterprise Mỹ đang dùng coding tools built on Chinese models - đó là fact, không phải speculation. Và nếu geopolitics thay đổi, hoặc Moonshot đơn giản quyết định revoke license cho competitor, toàn bộ ecosystem của các tools như Cursor đột ngột mất base. Kimi K2.5 hôm nay là Modified MIT. Ngày mai, Bắc Kinh có thể có quan điểm khác.

Nhưng phải công bằng - Cursor có lý

Trước khi đi đến kết luận, tôi muốn trình bày argument mạnh nhất bên phía Cursor. Vì công bằng mà nói, họ không hoàn toàn sai.

Open-source nghĩa là ai cũng có quyền dùng. Kimi K2.5 được phát hành dưới Modified MIT License. Cursor có quyền fine-tune và thương mại hóa - đó là mục đích của open-source. Và nếu "1/4 compute" claim đúng - tức Cursor bỏ 75% compute vào continued pre-training và RL - thì Composer 2 không đơn giản là "Kimi K2.5 đổi tên". Nó là derivative work với giá trị gia tăng đáng kể.

Hơn nữa, mọi AI company đều xây trên vai người khác. OpenAI xây trên research của Google (Transformers). Anthropic xây trên research của OpenAI. Llama xây trên cùng methodology. Không ai tự phát minh mọi thứ từ đầu. Và nếu Cursor mua quyền truy cập qua Fireworks AI, về mặt kỹ thuật họ không trực tiếp vi phạm license - đó là vấn đề giữa Fireworks và Moonshot.

Tất cả đều là arguments hợp lệ. Nhưng chúng không giải quyết được vấn đề core.

Cái giá thật của "quên ghi nguồn"

Vấn đề không phải là Cursor dùng Kimi K2.5 - họ có quyền làm điều đó.

Vấn đề là narrative. Cursor raise $2.3 tỉ USD ở vòng Series D với valuation $29.3B dựa trên câu chuyện "AI research company" - "our first continued pretraining run". Investors đang trả giá cho assumption rằng Cursor có proprietary technology moat. Khi "proprietary" thực chất là RL fine-tuning trên open-source model - với base model mà bất kỳ ai cũng có thể download từ HuggingFace (4.5 triệu downloads/tháng) - moat đó mỏng hơn nhiều so với narrative.

Và đây là con số đáng suy nghĩ nhất: Moonshot đang fundraise ở $18B valuation. Cursor ở $29.3B. Nếu Composer 2 - sản phẩm flagship mới nhất của Cursor - thực chất là fine-tuned Kimi K2.5, thì phần lớn "AI intelligence" đến từ công ty có valuation thấp hơn 38%. Base model provider có giá trị thấp hơn wrapper company. Đó là distortion mà thị trường chưa price in.

Câu hỏi mà không ai muốn trả lời

Composer 2 là model tốt - performance data không nói dối và Cursor users sẽ thấy sự cải thiện thực sự. Nhưng scandal này không phải về chất lượng model. Nó về câu hỏi mà ecosystem AI đang tránh né: moat thực sự của các AI tools company nằm ở đâu?

Câu trả lời của Cursor, revealed qua incident này: moat nằm ở UX integration và distribution - 4 triệu developers đã quen workflow. Không phải ở model. Không phải ở research. Đó là lý do Fynn phát hiện model ID trong plain text mà user base không collapse - vì users không dùng Cursor vì "proprietary AI". Họ dùng vì nó integrate vào workflow tốt nhất.

Nhưng "moat là UX" không sustain $29.3B valuation ở mức P/S ratio hiện tại - đặc biệt khi gross margin âm. Toàn bộ ngành AI tools đang trade at venture multiples dựa trên assumption về proprietary technology moat, trong khi thực tế phần lớn là integration layer trên open-source Trung Quốc. Attribution scandal chỉ là triệu chứng bề mặt.

Nếu bạn là founder đang build trên open-source: đọc license trước khi ship. Modified MIT không phải MIT. Và đừng marketing "AI research" khi bạn đang fine-tune. Community có debug proxies và sẽ tìm ra - như Fynn đã làm trong vài giờ.

Còn nếu bạn đang theo dõi AI industry - trend đáng watch nhất lúc này không phải "AI company nào mạnh nhất". Mà là ai đang build trên model của ai, và chuỗi phụ thuộc đó sẽ ra sao khi geopolitics thay đổi.

Tài liệu tham khảo

- TechCrunch - Cursor admits model built on Moonshot's Kimi (03/2026)

- VentureBeat - Cursor's Composer 2 was secretly built on a Chinese AI model (03/2026)

- The Open Source Press - CURSOR SHIPPED KIMI K2.5 AS THEIR OWN MODEL (03/2026)

- Fynn's original tweet - @fynnso (03/2026)

- Cursor blog - Composer 2 (03/2026)

- Anthropic - Detecting and preventing distillation attacks (02/2026)

- CNBC - Anthropic accuses Chinese labs of distilling Claude (02/2026)

- arXiv - Kimi K2.5: Visual Agentic Intelligence (02/2026)

- arXiv - Kimi K2: Open Agentic Intelligence (07/2025)

- arXiv - Kimi k1.5: Scaling Reinforcement Learning with LLMs (01/2025)

- Fortune - The rise and uncertain future of $29B Cursor (03/2026)

- TechCrunch - Cursor surpasses $2B ARR (03/2026)

- HuggingFace - moonshotai/Kimi-K2.5

- GitHub - MoonshotAI/Kimi-K2.5

- Security Boulevard - Moonshot AI governance breakdown (03/2026)

- MindStudio - Cursor Composer 2 & Kimi K2.5 attribution analysis (03/2026)

- Hacker News - Discussion thread (03/2026)

- IntuitionLabs - Kimi K2 Technical Deep Dive

- Philschmid - How Kimi, Cursor, and Chroma Train Agentic Models with RL

- CNBC - Cursor raises $2.3B at $29.3B valuation (11/2025)

- Artificial Analysis - Claude Opus 4.6 vs Kimi K2.5

- OpenRouter - Claude Opus 4.6 vs Kimi K2.5 comparison